hg真人游戏官方网站 UniPat AI开源SWE-Vision: 五百行代码打造SOTA视觉智能体!

机器之心报谈

多模态大模子在代码智力上杰出惊东谈主,但在基础视觉任务上却时常格外。UniPat AI 构建了一个极简的视觉智能体框架 ——SWE-Vision,让模子可以编写并实行 Python 代码来处理和考证我方的视觉判断。在五个主流视觉基准测试中,SWE-Vision 均达到了现时最优水平。

官网议论:https://unipat.ai

博客议论:https://unipat.ai/blog/SWE-Vision

开源地址:https://github.com/UniPat-AI/SWE-Vision

01|模子看得见,却没法精准处理

多模态大模子的代码智力在畴昔一年得到了惊东谈主进展 —— 寂然搭建形势、排查 bug、完成复杂重构,发扬已可并列资深工程师。关连词在 "认知视觉寰宇" 这件事上,它们的发扬远莫得代码智力那样可靠。UniPat AI 此前发布的多模态基准 BabyVision 就揭示了这一气候:模子时常给出大段看似合理的推理,却在最基础的计量、计数和空间关系判断上出错。

UniPat AI 此前发布的多模态认知 benchmark BabyVision 已被多个近期发布的重磅模子产物纳入评测体系,并在其技巧讲演中被援用,体现了社区对这一问题的闲居关切。

当咱们仔细注目 BabyVision 中模子出错的案例时,可以发现一个枢纽点:问题往往是 "模子看见了,却无法精准处理":

阅读柱状图时,模子能感知到 "简陋 75%",但无法精准遐想比值;

在复杂场景上钩数时,模子可能识别了每一个物体,但在逐个盘点时出错;

态状空间位置时,模子能给出定性判断,但难以踏实进行距离遐想和几何推理。

面临这些谬误,东谈主类通常会怎样作念?

掏出器用:画支持线、作出标志、用尺测量、用笔遐想。

这个不雅察激发了一个枢纽测度:既然模子一经极其擅长编程,能否让它用代码 —— 这个它最熟悉的器用 —— 来弥补视觉处理中的精度短板?

SWE-Vision 恰是对这一测度的系统性考证。

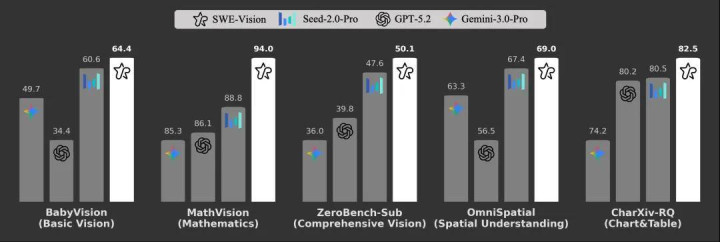

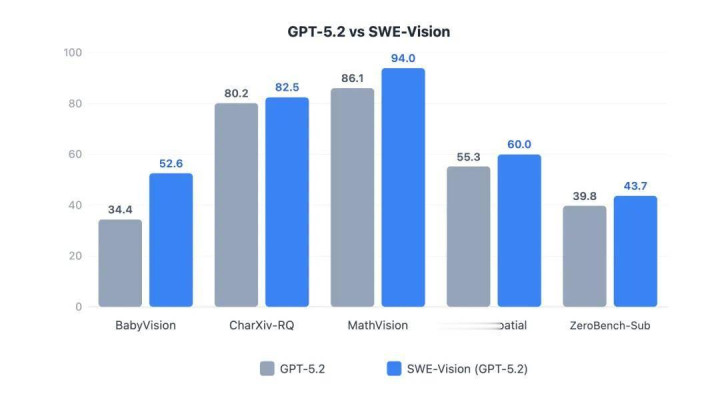

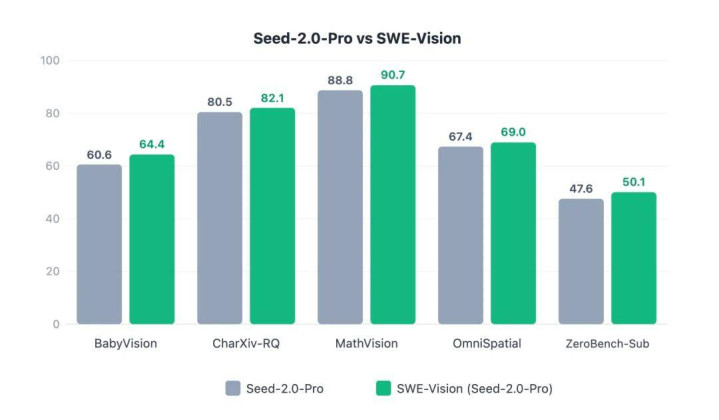

其成果令东谈主注意:在五个不同的视觉基准测试中 —— 涵盖基础感知、图表推理、数常识题处罚、空间认知和复杂的多设施视觉挑战 ——SWE-Vision 均普及了前沿 LLM 的发扬,如 GPT-5.2-xhigh 和 Seed-2.0-Pro,并得到了起初进的成果:在 BabyVision 上达到 64.4,在 MathVision 上达到 94.0,在 Zero-Bench-Sub 上达到 50.1,在 OmniSpatial 上达到 69.0,在 CharXiv-RQ 上达到 82.5。

02|SWE-Vision 是什么:一个「极简视觉智能体」

SWE-Vision 并不需要再造一堆专用视觉器用,而是把要作念的事压缩到极简:

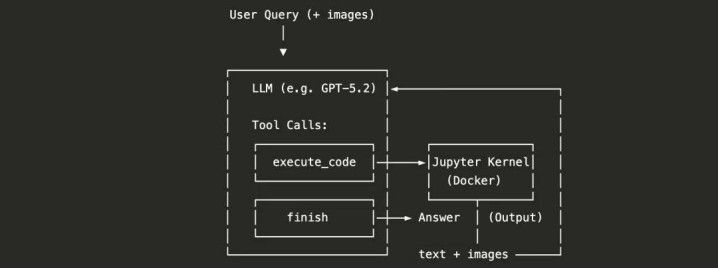

2.1 器用层:只保留两个器用

config.py 里界说的器用惟一两个:execute_code 和 finish。

execute_code:让模子在一个可继续保留景况的 Jupyter 环境里实行 Python

finish:当模子征服谜底正确时输出最终谜底

这里最枢纽的不是 “能实行代码”,而是器用接口自身十分小、十分通用。SWE-Vision 莫得给模子塞一堆专用视觉 API,而是只显现一个模子原本就很熟悉的动作:写 Python。

2.2 斥逐层:一个表率的 agentic loop

agent.py 里的 VLMToolCallAgent 末端了圆善的轮回:先把用户问题和图片组织成音信;然后调用复古 tool use 的聊天接口;要是模子发起 execute_code,就把代码送到 notebook 内核实行;再把实行成果行动 tool message 回流给模子;模子据此决定陆续调用器用照旧 finish。repo 里默许 tool_choice="auto",并复古 reasoning 模式;在开启时会把推理 effort 设为高级,并允许最多 100 轮迭代。

2.3 实行层:Docker 里的历久化 Jupyter kernel

kernel.py 不是大致 exec 一段代码,而是慎重启动一个 Docker 容器,再在容器里拉起 ipykernel。宿主侧通过 jupyter_client.BlockingKernelClient 议论这个内核,并从 IOPub /shell 通谈麇集实行成果。内核是历久化的,变量、导入、图像对象和中间成果齐能跨屡次 execute_code 保留;同期代码启动在结巴的 Docker 环境里,宿主与容器通过挂载目次交换文献。kernel.py 还会在启动后作念 health check,并把 matplotlib 后端成立成 inline,以便捏取图像输出。

大致来说,SWE-Vision 不免强模子每题齐写代码,但给它一个随时可用况且熟悉的 “视觉器用库”。

03|一次苦求在系统里到底怎样流动:从看图推理到带图轮回考证

SWE-Vision 像一个会看图的数据科学家,其圆善使命流如下:

1. 用户给问题 + 图片

2. 模子先念念考:这题能不可平直答?需不需要遐想 / 考证?

3. 需要就调用 execute_code:在 Notebook 里用 PIL / NumPy /matplotlib 等作念分析

4. 代码输出(数值 / 报错 / 可视化图)回流给模子

5. 模子陆续迭代,直到调用 finish 给最终谜底

澳门新浦京游戏下载官网

它有几个枢纽遐想:

有景况的实行环境:变量、导入、图片加载齐能跨屡次调用保留

Docker 沙箱:确保可控安全环境 + 复现性;

Image-in / Image-out:意味着模子不仅能读取输入图像,还能将我方生成的可视化成果回传给自身进行考证 —— 这是末端自我纠错的枢纽;

OpenAI function calling 表率接口:保证了与主流模子的开箱即用兼容性。

这套遐想的价值在于:允许模子像一个实在的科学家相似,先作念践诺再下论断。

04|为什么 stateful notebook 比一次性 code executor 更枢纽

好多东谈主第一次看 SWE-Vision 会以为,它不外是在 VLM 外面加了个 Python 器用。实在的死别其实在于 stateful。在 SWE-Vision 中内核景况会在屡次调用间保留;这意味着模子可以像东谈主类分析师那样分步使命:第一轮先读图、查验尺寸;第二轮编著局部、看边际;第三轮统计面目或测距离;第四轮画支持线作念阐述;临了再生成谜底。

要是代码实行是无景况的,这种多步分析会十分广泛:每一步齐要再行导入库、重载图片、重建变量,HoGaming模子也更难艳羡中间假定。SWE-Vision 通过历久化 kernel,把 “多轮器用调用” 变成了 “团结个 notebook 会话里的连气儿践诺”。从工程末端上看,这亦然它为什么能处理图表测量、空间关系和复杂多步视觉任务,而不仅仅作念一次性的 OCR 或检测。

05|SWE-Vision 的枢纽在于「能考证我方的视觉判断」

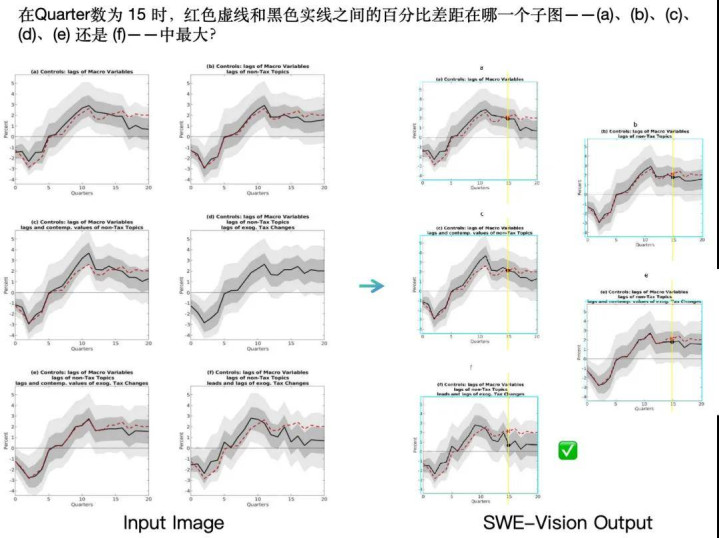

在 SWE-Vision「不雅察科学图表、转头端正」的案例中,咱们看到了一种天悬地隔的步履模式。如下图所示,这是科研场景中常见的图表分析任务:咱们条件模子判断,在 Quarters = 15 时,哪一张子图中红色虚线与玄色实线之间的差距最大。

SWE-Vision 智能体给出了一套极其严谨且可讲授的解法。率先,它扼杀了不存在红色虚线的子图(d);随后,对每一张候选子图在 Quarters = 15 处精准绘图支持线,定位红线与黑线的交点;接着,通过可实行代码精准遐想两条弧线在该位置的数值差距;最终基于遐想成果给出正确谜底。

这种 “先结构化分析、再治安化测量、临了数值考证” 的念念维与行动闭环,与传统视觉言语模子依赖直观式 “瞋目不雅察” 平直给出谜底的方式变成较着对比。它不仅权贵普及了成果的可靠性与可讲授性,也展示出更高的智力上限与更强的泛化后劲。

06|为什么极简遐想反而更强

SWE-Vision 的一个垂危论断是:对视觉任务而言,加入通用代码器用,是普及前沿多模态模子视觉智力的一个有用 test-time scaling 主见。

它之是以有用,正好在于其极简:

器用数目少,决策范围显明;

器用语义与模子已有智力高度一致;

复古多轮迭代和景况蕴蓄;

中间成果可被再次不雅察,而不是一次性复返文本;

不绑定某个特定 benchmark 的专用手工战略。

这与好多 “为了某类视觉任务单独发明一套器用接口” 的方法不同。这些方法往往在某些窄任务上能普及,但泛化性不及;而 SWE-Vision 的目的,是提供一个尽可能通用的视觉增强框架,让模子我方决定何时调用代码、怎样组织分析设施。

07|五大基准全线普及:愈加通用的 “视觉智力增强器”

SWE-Vision 在五个袒护面很广的视觉基准上进行了评测(基础感知、图表、数学、空间、轮廓多步推理),中枢发现高度一致:引入代码实行智力,能系统性地抬升前沿模子的视觉发扬上限。

在对比践诺中(团结模子 vs SWE-Vision),SWE-Vision 对两个前沿的视觉言语模子(GPT-5.2,Seed-2.0)齐带来权贵普及:

“反直观” 的少许是:

普及幅度最大的,往往不是最复杂的高阶推理任务,而是最基础的感知和精准处明智力 —— 举例 BabyVision 中的计数、面目识别和空间关系判断。这类任务东谈主类靠直观加大致器用就能踏实完成,而模子仅凭 "言语化视觉" 则极易忽略细节、数错个数、衰败考证技能。

SWE-Vision 的成果也给咱们揭示了另一种可能:

关于视觉来说,测试时推广(test-time scaling,TTS)不一定只可靠 “多想几段笔墨”,也可以靠 “多写几行代码” 来看得更详细。

08|畴昔的发展主见:让 “代码增强视觉” 变成视觉智能体的原生智力

与用于西宾多模态 LLMs 的传统数据(基本上是问题,图片,谜底三元组)不同,西宾视觉智能体模子需要多模态交错的智能体轨迹。它还需要一个交互式环境来复古强化学习、器用使用和评估,使模子不仅能学习呈文问题,还能学习感知、行动和反念念,要绝对开释 “器用增强视觉” 的后劲,模子需要更多深度交汇的视觉 - 编程 SFT/RL 数据与环境,来学会感知、行动和反念念。

具体而言,下一步的枢纽主见包括:

判断时机:学会识别何时视觉推理需要代码支持,何时可以平直呈文

中间考证:在多步推理流程中主动老练中间成果的正确性

失败规复:在代码决议无效时实时跳出,切换到替代战略

原生会通:让 "不雅察" 与 "遐想" 不再是两个寂然设施,而是深度会通,一体两面

SWE-Vision 的开源代码已在 GitHub 发布。编程支持的精准视觉认知是一个值得社区共同探索的主见 —— 五百行代码的极简框架hg真人游戏官方网站,也许是这段旅程一个可以的起始。

备案号:

备案号: